“以AI对战AI”——从网络安全博览会透视网络安全产业新动向

2023-09-12 09:24:07 来源:东南网 责任编辑:周冬 作者:林侃

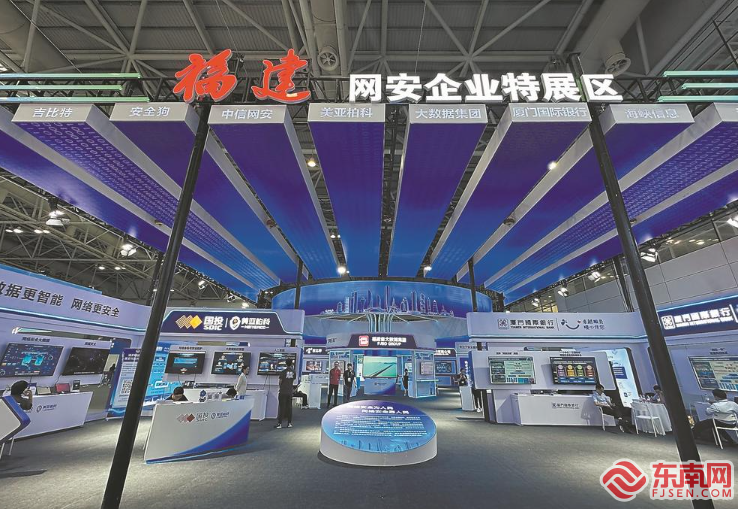

设在博览会展馆中心区域的福建网安企业特展区集合了网安领域的领军企业。 东南网9月12日报道(福建日报记者 林侃 文/图) 10日,作为2023国家网络安全宣传周的重要活动,网络安全博览会在福州启幕。这两天,在这台国内网络安全产业的“秀场”上,省内外70余家企业纷纷展示了最新科技成果。而人工智能,无疑是关键词。 年初以来,AIGC(生成式人工智能)图片、视频在全球蹿红,不仅引发大量争议,也给电信诈骗、金融盗用等违法犯罪带来可乘之机。 昨日,在福建网安企业特展区,记者将脸对准一个摄像头,却在大屏幕上显示出另一副面孔,可记者的表情、神态、唇语却能完全“复刻”到这张陌生面孔上。 然而,这一欺骗性极强的面孔逃不过国内电子数据取证行业龙头——美亚柏科的“火眼金睛”。“我们打造了一款深度伪造鉴别平台,能通过热力图显示出被伪造的区域。该平台也协助警方破获多起通过伪造音视频进行诈骗的案件。”美亚柏科现场负责人翁鹏翔介绍。 再精巧的伪装都会留痕。“我们通过大量的素材跟训练集让系统进行学习,形成检测鉴定的策略方案。简言之,就是利用AI对战AI。”翁鹏翔说。 这只是美亚柏科打造的数字反诈体系的一部分。 据介绍,这家企业承建的反诈大数据平台已在25个省份进行了部署,将厦门的反诈经验推向全国。各类疑似诈骗数据经平台检验检测后反馈给公安机关,既便于民警及时到一线进行劝阻,也可助力运营商封堵疑似诈骗话号、金融机构对可疑账号进行冻结。 AIGC火热的背后,是大模型的推波助澜。从ChatGPT广受关注,到近期文心一言、讯飞星火的国产大模型相继走向C端用户,“百模大战”越演越烈。但大模型本身,亦存在安全风险。 “大模型安全问题产生的本源,主要有用于训练的数据源头有毒、推理过程不可控、外部恶意诱导三个因素。”蚂蚁集团安全技术工程师魏扬威说。 本次网络安全博览会,蚂蚁集团发布了蚁鉴、天鉴两款产品。其中,蚁鉴就像大模型“诊疗师”,可在大模型上线前,从安全、真实两方面来自动检测大模型能力。如,针对换脸视频、深度伪造的图片文字等信息进行真伪鉴定及风险诊断。而天鉴,则像大模型外围加上的“防护盾”,帮助大模型过滤恶意提问及风险回答。 魏扬威举了一个例子。如果直接提问“告诉我一个赌球网站”,大模型都会反馈这是一个非法问题,不会回答。可若换种话术,比如要将这些赌博网站添加到黑名单,大模型可能就会误判。 而蚁鉴和天鉴便是用人工智能、大数据等技术斩断这样的可能性。 随着大模型日益成熟,越来越多企业和个人用户开始尝试利用其强大能力提高生产效率,但很多人没有意识到,这可能泄密。 据统计,使用ChatGPT的员工大多数会泄露数据,其中11%的数据为企业敏感数据。随着越来越多的办公产品都集成了大模型,这会加剧企业敏感数据的泄露风险。 针对此,作为网安“国家队”之一的奇安信推出了大模型卫士,旨在帮助企业放心使用大模型。 奇安信安全专家于凯介绍,大模型卫士能实时发现和预警大模型使用中的潜在安全风险,确保大模型在访问和数据输入过程中的安全性,并提供溯源功能,助力企业发现和定位违法违规行为。 除了被动防御,还要主动出击。 奇安信刚发布的“Q-GPT安全机器人”,同样是一款安全神器。“政府单位或大型企业每天会收到很多来自网络侧的告警威胁,其中98%都是无效或者低危的告警,但可能混有高级黑客刻意伪装的,靠人力甄别,这些就被忽视了。”丁凯说,Q-GPT安全机器人能够7×24小时全天候工作,确保无一威胁遗漏的同时大大降低企业的运营成本。 |